Клуб „Журналист“ към СБЖ, София

EUalive, общоевропейска медия и член на консорциума AI4Debunk, организира обществена дискусия, насочена към проучване на начините, по които инструментите, задвижвани от ИИ, могат да подкрепят усилията за борба с фалшивите новини и дезинформацията. Събитието събра журналисти и граждани, за да обсъдят реалните нужди, очаквания и опасения, свързани с проверката на фактите, изкуствения интелект и доверието на медиите.

Участници

Общо 12 участници присъстваха на фокус групата. Повечето от тях са професионални журналисти, предимно на възраст над 60 години, с по-консервативни възгледи. Участниците съобщават, че консумират информация главно чрез онлайн новинарски медии, телевизия и печатни медии, като същевременно определят Facebook и онлайн новинарските платформи като основните източници, където най-често се сблъскват с дезинформация.

Преодоляване на невярна информация за събитието

Дискусията започна с развенчаването на неверни твърдения относно самото събитие. Съюзът на българските журналисти (СБЖ) категорично отхвърли твърденията, че е поканил „беларуски пропагандисти“ за финансирано от ЕС обучение за борба с фалшивите новини. Председателят на СБЖ заяви, че обвиненията произтичат от подвеждаща публикация на беларуската държавна медия „Минск нюз“ и по-късно бяха повторени от беларуските опозиционни медии без проверка.

В действителност събитието беше едночасова обществена дискусия, озаглавена „Изкуствен интелект и фалшиви новини: Какво е работното решение?“, организирана от EUalive и настанена в сградата на СБЖ. Дискусията продължи по план въпреки медийния спор, като подчерта колко бързо дезинформацията може да се разпространи дори в професионалните медийни кръгове.

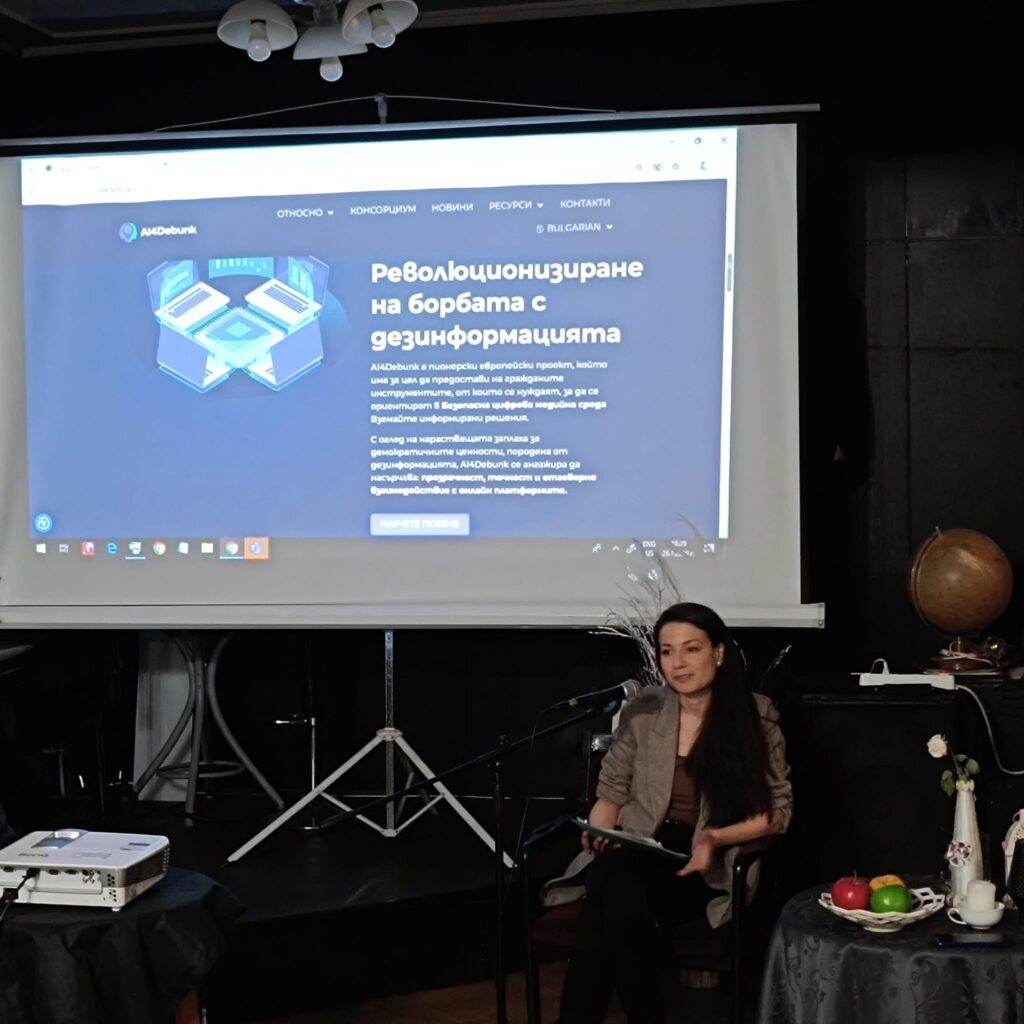

Представяне на проекта AI4Debunk

Екипът на EUalive, ръководен от Георги Готев, представи проекта AI4Debunk, като очерта неговите цели, партньори в консорциума и напредъка до момента. Представител на F6S предостави допълнителна информация за технологичните аспекти на проекта и ролята на партньорските организации. Беше подчертано, че проектът има ясно определен и ограничен обхват: подпомагане на ползвателите при идентифицирането и оценката на дезинформацията, вместо да се решават по-широки системни проблеми, като например генерирането на синтетични изображения или цялостното регулиране на ИИ.

Основни дискусионни теми

Участниците обсъдиха подробно ролята на изкуствения интелект в информационната екосистема. Бяха обсъдени няколко примера, за да се илюстрира как непълната или селективно представена информация може да генерира дезинформация, включително случаи, свързани с исторически послания и международно отразяване на новини.

Повтаряща се тема беше двойствената природа на ИИ. Докато някои участници разглеждаха ИИ като потенциално мощен инструмент за проверка и проверка на фактите, други изразиха загриженост относно злоупотребата с него, особено при генерирането на синтетичен текст, изображения и статии, които могат да подведат аудиторията. Бяха повдигнати и въпроси, свързани с ОРЗД, защитата на източниците и способността на журналистите да защитават работата си срещу генерирано от ИИ съдържание.

Дискусията подчерта, че системите с ИИ са толкова надеждни, колкото и данните, на които са обучени. Тъй като онлайн информацията често е неточна, пристрастна или умишлено подвеждаща, участниците се съгласиха, че от ИИ не може да се очаква последователно да създава обективна истина. Това ограничение засилва значението на медийната грамотност, човешката преценка, професионалните стандарти и редакционната отговорност.

Медийна грамотност, доверие и професионална отговорност

Няколко участници подчертаха, че медийната грамотност остава най-критичната защита срещу дезинформацията както сега, така и в бъдеще. Журналистите и гражданите трябва да могат да оспорват собствените си убеждения, да излизат извън алгоритмичните „информационни балони“ и да търсят различни източници. Бяха изразени опасения относно аудиторията, която очаква ИИ да предостави абсолютна истина, което може да увеличи уязвимостта към дезинформация, генерирана или подсилена от системите с ИИ.

Проучване, проведено по време на дискусията, показа, че повечето участници вече използват инструменти с ИИ в професионалната си работа. Модераторът подчерта значението на обществените механизми за проверка на информацията, както и необходимостта от образование относно начина на работа на ИИ, включително бързо формулиране и критична оценка на резултатите от ИИ. Беше обсъдена и ролята на образователните системи, по-специално въвеждането на ИИ и медийната грамотност в училищата.

Авторско право и творчески индустрии

Въпросът за авторското право се очертава като основен проблем. Участниците отбелязаха, че обезщетението за нарушаване на авторските права в България в момента е минимално, което повдига въпроси за това как автори, журналисти, художници и музиканти могат да защитят работата си в ерата на генеративния ИИ. Някои участници изразиха силни мнения, че ИИ представлява пряка заплаха за творческите индустрии, като един журналист заяви, че ИИ следва да бъде изцяло забранен за художествено производство.

Участниците попълниха анкета, обобщена по-долу:

Излагане на дезинформация

Участниците посочиха, че най-често се сблъскват с дезинформация относно Фейсбук и във онлайн новинарски медии.

Практики за проверка

На въпроса как проверяват информацията, която подозират, че може да е невярна или подвеждаща, респондентите съобщават, че разчитат предимно на:

- Търсачки

- Официални източници,

- Дискусии с колеги, приятели

Предпочитани формати на доказателства

- Кратки писмени обяснения, които ясно очертават защо съдържанието е подвеждащо

- Преки връзки към надеждни онлайн източници в подкрепа на корекцията или изясняването

Съобщаване за дезинформация

Участниците бяха попитани как биха предпочели да сигнализират или съобщават за дезинформация или фалшиви новини. Най-облагодетелстваните механизми за докладване включваха:

- Разширения на браузъра, които позволяват на потребителите да маркират съдържанието директно в своята среда за сърфиране

- Мобилни приложения, предлагащи достъпност и лекота на използване

Предпочитани системни характеристики

На въпроса кой вид система би бил най-полезен за разпознаване на дезинформацията, респондентите посочиха следните варианти:

- Мобилно приложение

- Функция, интегрирана директно в платформите

- Публична база данни с възможност за търсене на проверени случаи

- Предупреждения или етикети с помощта на ИИ

Представяне на доказателства и обратна връзка

Респондентите изразиха предпочитание за представяне на доказателства под формата на обикновена връзка към онлайн източник, съдържащ съответната информация. Освен това беше изразено категорично съгласие, че потребителите следва да получават обратна информация след подаването на доклад, като повечето респонденти посочиха, че потвърждението или последващите действия ще повишат доверието в инструмента и ще продължат да го използват.

Мотивация за използване на инструмент за развенчаване

Запитани за основната си мотивация за използване на инструмент за откриване или докладване на дезинформация, респондентите посочиха:

- Борба с дезинформацията

- Подобряване на цялостното качество на информацията

- Принос към обществения дебат

Основни опасения и рискове

И накрая, респондентите установиха няколко опасения, свързани с инструменти, които изискват от потребителите да представят доказателства:

- Риск от неправилно валидиране на информацията

- Време, необходимо за използване на инструмента

- Потенциална злоупотреба от страна на други лица

- Предубеждения в автоматизираните системи

- Опасения, свързани с неприкосновеността на личния живот и защитата на данните