Klubben "Journalist" ved sammenslutningen af bulgarske journalister, Sofia

EUalive, et paneuropæisk medieforetagende og medlem af AI4Debunk-konsortiet, afholdt en offentlig debat med det formål at undersøge, hvordan AI-drevne værktøjer kan støtte bestræbelserne på at bekæmpe falske nyheder og desinformation. Arrangementet samlede journalister og borgere for at drøfte virkelige behov, forventninger og bekymringer vedrørende faktatjek, kunstig intelligens og medietillid.

Deltagere

I alt 12 deltagere deltog i fokusgruppen. De fleste var professionelle journalister, overvejende over 60 år, med generelt mere konservative synspunkter. Deltagerne rapporterede, at de primært forbruger oplysninger gennem onlinenyheder, tv og trykte medier, samtidig med at de identificerede Facebook og onlinenyhedsplatforme som de primære kilder, hvor de oftest støder på desinformation.

Håndtering af misinformation om begivenheden

Diskussionen blev indledt med afsløringen af falske påstande om selve begivenheden. Sammenslutningen af bulgarske journalister (UBJ) afviste kategorisk påstandene om, at den havde inviteret "hviderussiske propagandister" til EU-finansieret uddannelse i bekæmpelse af falske nyheder. Formanden for UBJ anførte, at beskyldningerne stammede fra en vildledende offentliggørelse fra den belarusiske statslige medie Minsk News og senere blev gentaget af belarusiske oppositionsmedier uden kontrol.

I virkeligheden var arrangementet en offentlig debat af en times varighed med titlen "Artificial Intelligence and Fake News: What Is the Working Solution?", arrangeret af EUalive og afholdt i UBJ's lokaler. Diskussionen forløb som planlagt på trods af mediekontroversen og fremhævede, hvor hurtigt desinformation kan spredes selv inden for professionelle mediekredse.

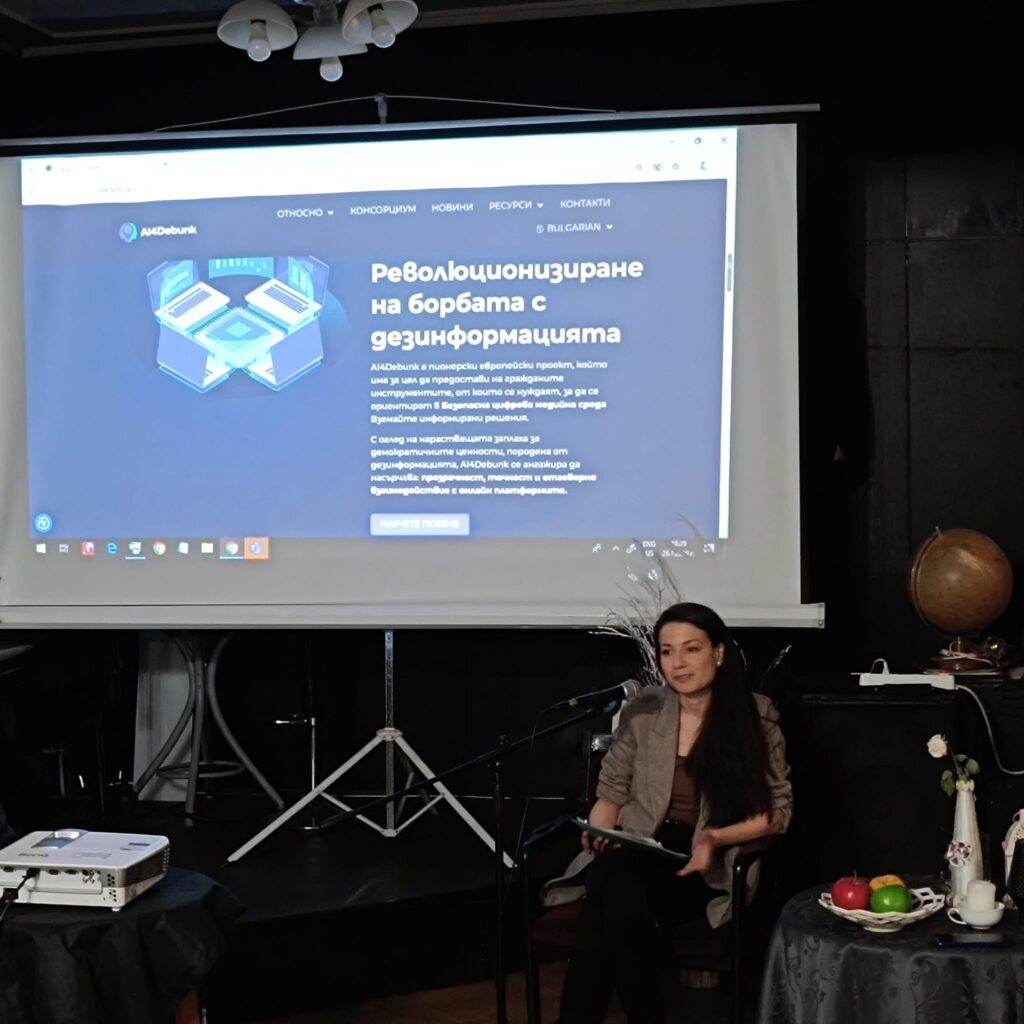

Præsentation af AI4Debunk-projektet

EUalive-teamet under ledelse af Georgi Gotev præsenterede AI4Debunk-projektet og skitserede dets mål, konsortiepartnere og hidtidige fremskridt. En repræsentant fra F6S gav yderligere indsigt i projektets teknologiske aspekter og partnerorganisationernes rolle. Det blev understreget, at projektet har et klart defineret og begrænset anvendelsesområde: støtte brugerne i at identificere og vurdere desinformation i stedet for at løse bredere systemiske problemer såsom generering af syntetiske billeder eller den overordnede regulering af kunstig intelligens.

De vigtigste diskussionstemaer

Deltagerne reflekterede i vid udstrækning over den rolle, som kunstig intelligens spiller i informationsøkosystemet. Flere eksempler blev drøftet for at illustrere, hvordan ufuldstændige eller selektivt præsenterede oplysninger kan generere desinformation, herunder sager vedrørende historiske fortællinger og international nyhedsdækning.

Et tilbagevendende tema var AI's dobbelte karakter. Mens nogle deltagere betragtede kunstig intelligens som et potentielt effektivt værktøj til faktatjek og verifikation, udtrykte andre bekymring over misbruget heraf, navnlig med hensyn til at generere syntetisk tekst, billeder og artikler, der kan vildlede publikum. Spørgsmål vedrørende GDPR, kildebeskyttelse og journalisters evne til at forsvare deres arbejde mod AI-genereret indhold blev også rejst.

Diskussionen fremhævede, at AI-systemer kun er så pålidelige som de data, de er uddannet i. Da onlineoplysninger ofte er unøjagtige, partiske eller bevidst vildledende, var deltagerne enige om, at kunstig intelligens ikke kan forventes konsekvent at frembringe objektiv sandhed. Denne begrænsning styrker betydningen af mediekendskab, menneskelig dømmekraft, faglige standarder og redaktionelt ansvar.

Mediekendskab, tillid og professionelt ansvar

Flere deltagere understregede, at mediekendskab fortsat er det mest kritiske forsvar mod desinformation, både nu og i fremtiden. Både journalister og borgere skal kunne udfordre deres egne overbevisninger, træde uden for algoritmiske "informationsbobler" og søge forskellige kilder. Der blev udtrykt bekymring over, at publikum forventer, at kunstig intelligens leverer absolut sandhed, hvilket kan øge sårbarheden over for desinformation, der genereres eller forstærkes af AI-systemer.

En meningsmåling, der blev foretaget under drøftelsen, viste, at de fleste deltagere allerede anvender AI-værktøjer i deres professionelle arbejde. Ordstyreren understregede betydningen af samfundsmæssige mekanismer til kontrol af oplysninger samt behovet for uddannelse i, hvordan AI fungerer, herunder hurtig formulering og kritisk evaluering af AI-output. Uddannelsessystemernes rolle, navnlig indførelsen af kunstig intelligens og mediekendskab i skolerne, blev også drøftet.

Ophavsret og kreative industrier

Spørgsmålet om ophavsret viste sig at være et stort problem. Deltagerne bemærkede, at kompensationen for krænkelse af ophavsretten i Bulgarien i øjeblikket er minimal, hvilket rejser spørgsmål om, hvordan forfattere, journalister, kunstnere og musikere kan beskytte deres arbejde i en alder af generativ kunstig intelligens. Nogle deltagere gav udtryk for stærke synspunkter om, at kunstig intelligens udgør en direkte trussel mod de kreative industrier, og en journalist argumenterede for, at kunstig intelligens bør forbydes helt fra kunstnerisk produktion.

Deltagerne udfyldte en undersøgelse, der er sammenfattet nedenfor:

Udsættelse for desinformation

Deltagerne anførte, at de oftest støder på desinformation om Facebook og i online nyhedsmedier.

Kontrolpraksis

Adspurgt om, hvordan de verificerer oplysninger, som de har mistanke om kan være falske eller vildledende, rapporterede respondenterne, at de primært stolede på:

- Søgemaskiner

- Officielle kilder

- Diskussioner med kolleger, venner

Foretrukne dokumentationsformater

- Korte skriftlige forklaringer, der klart beskriver, hvorfor indhold er vildledende

- Direkte links til pålidelige onlinekilder, der understøtter rettelsen eller præciseringen

Indberetning af desinformation

Deltagerne blev spurgt, hvordan de foretrækker at signalere eller indberette desinformation eller falske nyheder. De mest foretrukne rapporteringsmekanismer omfattede:

- Browserudvidelser, der giver brugerne mulighed for at markere indhold direkte i deres browsermiljø

- Mobile applikationer, der tilbyder tilgængelighed og brugervenlighed

Foretrukne systemfunktioner

Adspurgt om, hvilken type system der ville være mest nyttigt til at genkende desinformation, identificerede respondenterne følgende muligheder:

- Mobil applikation

- Funktion integreret direkte i platforme

- Offentlig, søgbar database over verificerede sager

- AI-støttede advarsler eller etiketter

Fremlæggelse af dokumentation og feedback

Respondenterne gav udtryk for, at de foretrak at fremlægge dokumentation i form af et simpelt link til en onlinekilde, der indeholder de relevante oplysninger. Desuden var der stærk enighed om, at brugerne bør modtage feedback efter indsendelse af en rapport, idet de fleste respondenter angav, at bekræftelse eller opfølgning ville øge tilliden til og den fortsatte brug af værktøjet.

Motivation for at bruge en Debunking Tool

Da respondenterne blev spurgt om deres primære motivation for at anvende et værktøj til afsløring eller rapportering af desinformation, nævnte de:

- Bekæmpelse af desinformation

- Forbedring af den generelle informationskvalitet

- Bidrag til den offentlige debat

Vigtige bekymringer og risici

Endelig påpegede respondenterne en række betænkeligheder vedrørende værktøjer, der kræver, at brugerne indsender dokumentation:

- Risiko for ukorrekt validering af oplysninger

- Tid, der kræves for at bruge værktøjet

- Potentiel misbrug af andre

- Bias i automatiserede systemer

- Bekymringer vedrørende privatlivets fred og databeskyttelse