‘Journalist ’ при Союзе болгарских журналистов, София

EUalive, общеевропейское СМИ и член консорциума AI4Debunk, организовал общественную дискуссию, направленную на изучение того, как инструменты на базе ИИ могут поддерживать усилия по противодействию фейковым новостям и дезинформации. Мероприятие собрало журналистов и граждан, чтобы обсудить реальные потребности, ожидания и проблемы, связанные с проверкой фактов, искусственным интеллектом и доверием СМИ.

Участники конференции

Всего в фокус-группе приняли участие 12 человек. Большинство из них были профессиональными журналистами, преимущественно старше 60 лет, с более консервативными взглядами. Участники сообщили о потреблении информации в основном через онлайн-новости, телевидение и печатные СМИ, определяя Facebook и онлайн-новостные платформы в качестве основных источников, где они чаще всего сталкиваются с дезинформацией.

Устранение недостоверной информации о событии

Дискуссия началась с развенчивания ложных утверждений относительно самого события. Союз болгарских журналистов (UBJ) категорически опроверг обвинения в том, что он пригласил “белорусских пропагандистов ” для финансируемого ЕС обучения по борьбе с фейковыми новостями. Председатель UBJ заявил, что обвинения возникли из-за вводящей в заблуждение публикации белорусского государственного издания Minsk News, а затем были повторены белорусскими оппозиционными СМИ без проверки.

“Artificial Intelligence and Fake News (англ.) (недоступная ссылка - история). What Is the Working Solution?”, организованный EUalive и размещенный в помещении UBJ. Дискуссия продолжалась, как и планировалось, несмотря на споры в СМИ, подчеркивая, как быстро дезинформация может распространяться даже в профессиональных медиа-кругах.

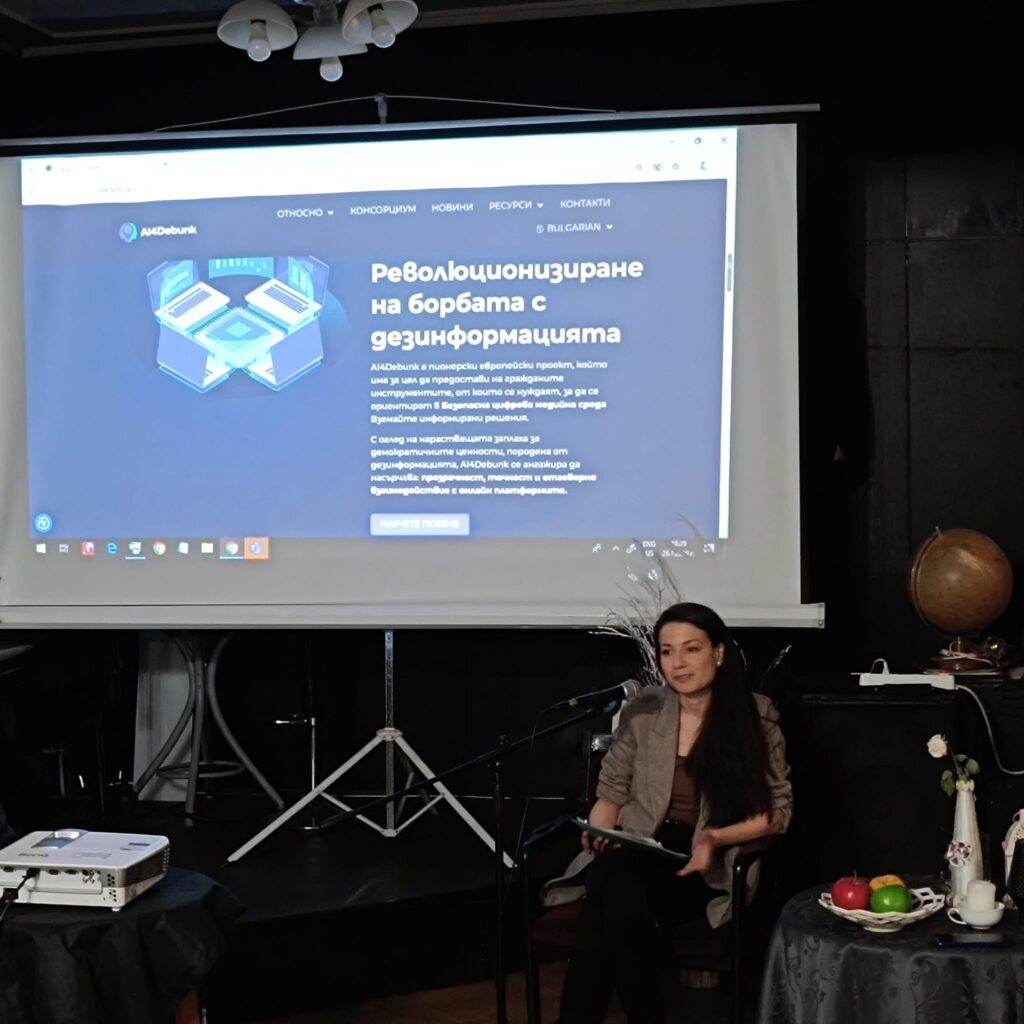

Презентация проекта AI4Debunk

Команда EUalive под руководством Георгия Готева представила проект AI4Debunk, изложив его цели, партнеров по консорциуму и прогресс на сегодняшний день. Представитель F6S представил дополнительную информацию о технологических аспектах проекта и роли партнерских организаций. Было подчеркнуто, что проект имеет четко определенный и ограниченный охват: Поддержка пользователей в выявлении и оценке дезинформации, а не решение более широких системных проблем, таких как генерация синтетических изображений или общее регулирование ИИ.

Ключевые темы обсуждения

Участники подробно обсудили роль искусственного интеллекта в информационной экосистеме. Было обсуждено несколько примеров, иллюстрирующих, как неполная или выборочно представленная информация может генерировать дезинформацию, включая случаи, связанные с историческими повествованиями и международным освещением новостей.

Повторяющейся темой была двойственная природа ИИ. В то время как некоторые участники рассматривали ИИ как потенциально мощный инструмент для проверки фактов и верификации, другие выразили обеспокоенность по поводу его неправильного использования, особенно при создании синтетического текста, изображений и статей, которые могут ввести в заблуждение аудиторию. Также были подняты вопросы, связанные с GDPR, защитой источников и способностью журналистов ’ защищать свою работу от контента, созданного ИИ.

В ходе обсуждения было подчеркнуто, что системы ИИ настолько надежны, насколько надежны данные, на которых они обучены. Поскольку онлайн-информация часто неточна, предвзята или намеренно вводит в заблуждение, участники согласились с тем, что нельзя ожидать, что ИИ будет последовательно производить объективную правду. Это ограничение усиливает важность медиаграмотности, человеческого суждения, профессиональных стандартов и редакционной ответственности.

Медиаграмотность, доверие и профессиональная ответственность

Несколько участников подчеркнули, что медиаграмотность остается наиболее важной защитой от дезинформации как сейчас, так и в будущем. Журналисты и граждане должны иметь возможность бросить вызов своим собственным убеждениям, выйти за пределы алгоритмических пузырей “information, ” и искать различные источники. Были высказаны опасения по поводу аудитории, ожидающей, что ИИ предоставит абсолютную правду, что может повысить уязвимость к дезинформации, создаваемой или усиливаемой системами ИИ.

Опрос, проведенный в ходе дискуссии, показал, что большинство участников уже используют инструменты ИИ в своей профессиональной работе. Модератор подчеркнул важность социальных механизмов проверки информации, а также необходимость обучения тому, как работает ИИ, включая быструю формулировку и критическую оценку результатов ИИ. Обсуждалась также роль систем образования, в частности внедрение ИИ и медиаграмотности в школах.

Авторское право и креативные индустрии

Проблема авторского права стала одной из основных проблем. Участники отметили, что компенсация за нарушение авторских прав в Болгарии в настоящее время минимальна, что вызывает вопросы о том, как авторы, журналисты, художники и музыканты могут защитить свою работу в эпоху генеративного ИИ. Некоторые участники выразили твердое мнение о том, что ИИ представляет прямую угрозу для творческих индустрий, а один журналист утверждал, что ИИ должен быть полностью запрещен к художественному производству.

Участники заполнили анкету, кратко изложенную ниже:

Воздействие дезинформации

Участники указали, что они чаще всего сталкиваются с дезинформацией о Facebook и в Интернет-СМИ.

Практика проверки

Отвечая на вопрос о том, как они проверяют информацию, которую они подозревают, может быть ложной или вводящей в заблуждение, респонденты сообщили, что в основном полагаются на:

- Категория: Поисковые системы

- Официальные источники,

- Обсуждения с коллегами, друзьями

Предпочтительные форматы доказательств

- Короткие письменные объяснения, которые четко объясняют, почему контент вводит в заблуждение

- Прямые ссылки на надежные онлайн-источники, поддерживающие исправление или уточнение

Сообщение о дезинформации

Участников спросили, как они предпочли бы сигнализировать или сообщать дезинформацию или фейковые новости. К числу наиболее предпочтительных механизмов отчетности относятся:

- Расширения браузера, позволяющие пользователям помечать контент непосредственно в своей среде просмотра

- Мобильные приложения, предлагающие доступность и простоту использования

Предпочтительные характеристики системы

Отвечая на вопрос, какой тип системы будет наиболее полезен для распознавания дезинформации, респонденты определили следующие варианты:

- Мобильное приложение

- Функция интегрирована непосредственно в платформы

- Публичная база данных проверенных случаев с возможностью поиска

- Предупреждения или ярлыки с помощью ИИ

Представление доказательств и обратной связи

Респонденты выразили предпочтение представлению доказательств в виде простой ссылки на онлайн-источник, содержащий соответствующую информацию. Кроме того, было выражено твердое согласие с тем, что пользователи должны получать обратную связь после представления отчета, причем большинство респондентов указали, что подтверждение или принятие последующих мер повысят доверие к этому инструменту и его дальнейшее использование.

Мотивация для использования инструмента разоблачения

Отвечая на вопрос об их основной мотивации для использования инструмента обнаружения дезинформации или отчетности, респонденты указали:

- Борьба с дезинформацией

- Повышение общего качества информации

- Вклад в общественную дискуссию

Основные проблемы и риски

Наконец, респонденты выявили несколько проблем, связанных с инструментами, которые требуют от пользователей представления доказательств:

- Риск неправильной проверки информации

- Время, необходимое для использования инструмента

- Потенциальное неправомерное использование другими

- Предвзятость в автоматизированных системах

- Проблемы конфиденциальности и защиты данных