Klub „novinář“ Svazu bulharských novinářů, Sofie

EUalive, celoevropský sdělovací prostředek a člen konsorcia AI4Debunk, uspořádal veřejnou diskusi, jejímž cílem bylo prozkoumat, jak mohou nástroje využívající umělou inteligenci podpořit úsilí v boji proti falešným zprávám a dezinformacím. Na této akci se sešli novináři a občané, aby diskutovali o skutečných potřebách, očekáváních a obavách souvisejících s ověřováním faktů, umělou inteligencí a důvěrou sdělovacích prostředků.

Účastníci

Fokusní skupiny se zúčastnilo celkem 12 účastníků. Většina z nich byli profesionální novináři, převážně starší 60 let, s obecně konzervativnějšími názory. Účastníci uvedli, že informace spotřebovávají především prostřednictvím on-line zpravodajských kanálů, televize a tištěných médií, přičemž Facebook a on-line zpravodajské platformy označili za primární zdroje, kde se nejčastěji setkávají s dezinformacemi.

Řešení dezinformací o akci

Diskuse byla zahájena vyvrácením nepravdivých tvrzení týkajících se samotné události. Unie bulharských novinářů (UBJ) kategoricky popřela tvrzení, že pozvala „běloruské propagandisty“ na školení o boji proti falešným zprávám financované EU. Předseda UBJ uvedl, že obvinění pocházejí ze zavádějící publikace běloruského státního deníku Minsk News a později byla bez ověření opakována běloruskými opozičními médii.

Ve skutečnosti se jednalo o hodinovou veřejnou diskusi s názvem „Umělá inteligence a falešné zprávy: What Is the Working Solution?“, kterou pořádá organizace EUalive a která je hostována v prostorách UBJ. Diskuse pokračovala podle plánu navzdory mediální kontroverzi a zdůraznila, jak rychle se dezinformace mohou šířit i v odborných mediálních kruzích.

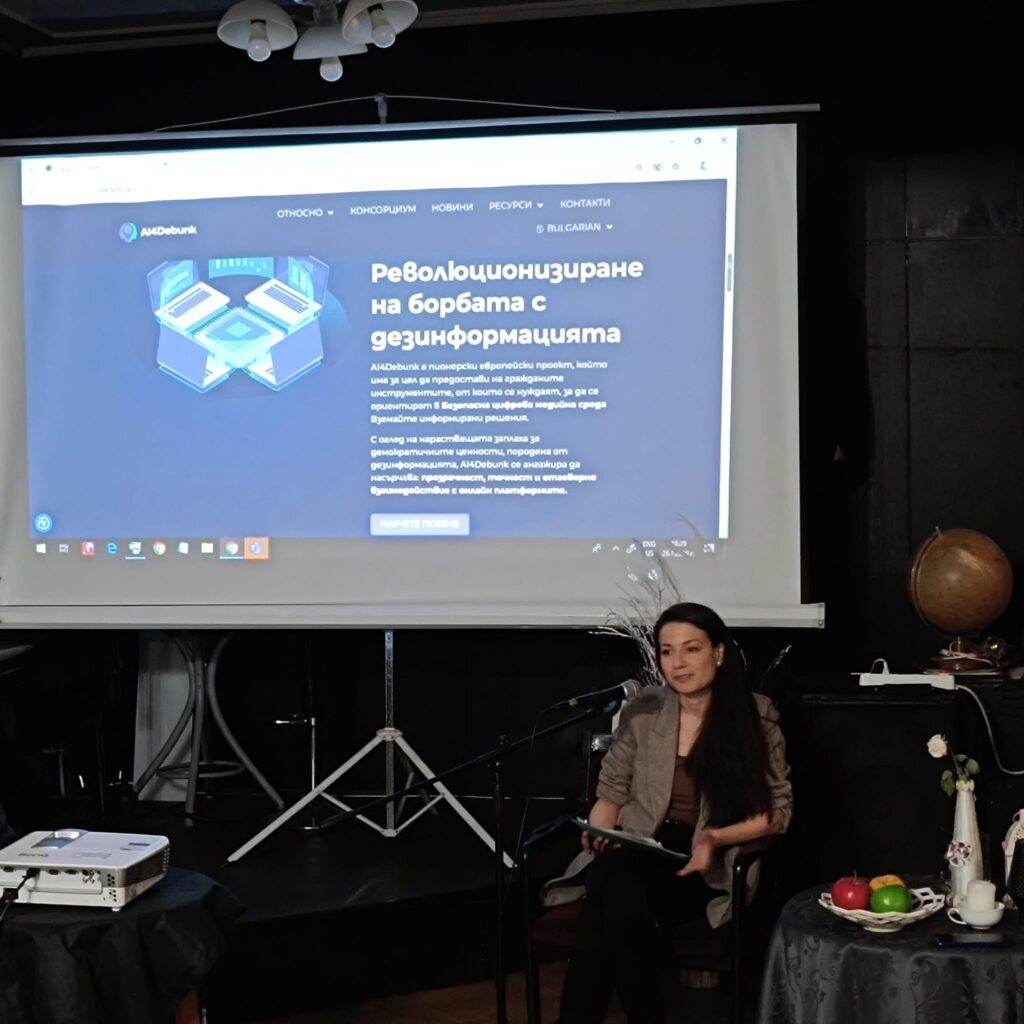

Prezentace projektu AI4Debunk

Tým EUalive pod vedením Georgiho Goteva představil projekt AI4Debunk a nastínil jeho cíle, partnery konsorcia a dosavadní pokrok. Zástupce F6S poskytl další informace o technologických aspektech projektu a úloze partnerských organizací. Bylo zdůrazněno, že projekt má jasně vymezený a omezený rozsah: podpora uživatelů při identifikaci a posuzování dezinformací, spíše než řešení širších systémových problémů, jako je vytváření syntetických obrazů nebo celková regulace umělé inteligence.

Klíčová témata diskuse

Účastníci se rozsáhle zamysleli nad úlohou umělé inteligence v informačním ekosystému. Bylo projednáno několik příkladů, které ilustrují, jak mohou neúplné nebo selektivně prezentované informace vytvářet dezinformace, včetně případů souvisejících s historickými narativy a mezinárodním zpravodajstvím.

Opakujícím se tématem byla duální povaha umělé inteligence. Zatímco někteří účastníci považovali umělou inteligenci za potenciálně účinný nástroj pro ověřování faktů a ověřování, jiní vyjádřili obavy ohledně jejího zneužití, zejména při vytváření syntetického textu, obrázků a článků, které mohou uvádět publikum v omyl. Byly rovněž vzneseny otázky týkající se obecného nařízení o ochraně osobních údajů, ochrany zdrojů a schopnosti novinářů bránit svou práci proti obsahu vytvořenému umělou inteligencí.

Diskuse zdůraznila, že systémy UI jsou pouze tak spolehlivé jako údaje, na nichž jsou trénovány. Vzhledem k tomu, že on-line informace jsou často nepřesné, zkreslené nebo záměrně zavádějící, účastníci se shodli na tom, že nelze očekávat, že umělá inteligence bude konzistentně produkovat objektivní pravdu. Toto omezení posiluje význam mediální gramotnosti, lidského úsudku, profesních standardů a redakční odpovědnosti.

Mediální gramotnost, důvěra a profesionální odpovědnost

Několik účastníků zdůraznilo, že mediální gramotnost je i nadále nejkritičtější obranou proti dezinformacím, a to jak nyní, tak i v budoucnu. Novináři i občané musí mít možnost zpochybnit své vlastní přesvědčení, vystoupit z algoritmických „informačních bublin“ a hledat různé zdroje. Byly vyjádřeny obavy ohledně publika, které očekává, že umělá inteligence přinese absolutní pravdu, což může zvýšit zranitelnost vůči dezinformacím generovaným nebo zesíleným systémy umělé inteligence.

Průzkum provedený během diskuse ukázal, že většina účastníků již používá nástroje umělé inteligence ve své profesionální práci. Moderátor zdůraznil význam společenských mechanismů pro ověřování informací, jakož i potřebu vzdělávání o tom, jak UI funguje, včetně rychlé formulace a kritického hodnocení výstupů UI. Diskutovalo se rovněž o úloze vzdělávacích systémů, zejména o zavádění umělé inteligence a mediální gramotnosti ve školách.

Autorská práva a kreativní odvětví

Problematika autorských práv se ukázala jako velmi znepokojivá. Účastníci poznamenali, že odškodnění za porušení autorských práv v Bulharsku je v současné době minimální, což vyvolává otázky o tom, jak mohou autoři, novináři, umělci a hudebníci chránit svou práci ve věku generativní umělé inteligence. Někteří účastníci vyjádřili silné názory, že umělá inteligence představuje přímou hrozbu pro kreativní odvětví, přičemž jeden novinář tvrdil, že umělá inteligence by měla být zcela zakázána z umělecké produkce.

Účastníci vyplnili dotazník shrnutý níže:

Vystavení dezinformacím

Účastníci uvedli, že se nejčastěji setkávají s dezinformacemi o Facebook a v online zpravodajská média.

Postupy ověřování

Na otázku, jak ověřují informace, o nichž mají podezření, že mohou být nepravdivé nebo zavádějící, respondenti uvedli, že se spoléhají především na:

- Vyhledávače

- oficiální zdroje,

- Diskuse s kolegy, přáteli

Upřednostňované formáty důkazů

- Krátká písemná vysvětlení, která jasně nastiňují, proč je obsah zavádějící

- Přímé odkazy na spolehlivé on-line zdroje podporující opravu nebo objasnění

Hlášení dezinformací

Účastníci byli dotázáni, jak by raději signalizovali nebo oznamovali dezinformace nebo falešné zprávy. Mezi nejoblíbenější mechanismy podávání zpráv patřily:

- Rozšíření prohlížeče, která uživatelům umožňují označovat obsah přímo v jejich prohlížecím prostředí

- Mobilní aplikace, které nabízejí přístupnost a snadné použití

Preferované funkce systému

Na otázku, jaký typ systému by byl pro rozpoznání dezinformací nejužitečnější, respondenti uvedli následující možnosti:

- Mobilní aplikace

- Funkce integrovaná přímo do platforem

- Veřejná databáze ověřených případů s možností vyhledávání

- Varování nebo štítky podporované umělou inteligencí

Předkládání důkazů a zpětné vazby

Respondenti dali přednost předložení důkazů ve formě jednoduchého odkazu na on-line zdroj obsahující příslušné informace. Kromě toho panovala silná shoda na tom, že uživatelé by měli po předložení zprávy obdržet zpětnou vazbu, přičemž většina respondentů uvedla, že potvrzení nebo následná opatření zvýší důvěru v tento nástroj a jeho další používání.

Motivace pro použití vylučovacího nástroje

Když byli respondenti dotázáni na jejich primární motivaci k používání nástroje pro odhalování dezinformací nebo podávání zpráv, uvedli:

- Boj proti dezinformacím

- Zlepšení celkové kvality informací

- Příspěvek k veřejné diskusi

Hlavní obavy a rizika

Respondenti rovněž poukázali na několik obav týkajících se nástrojů, které vyžadují, aby uživatelé předkládali důkazy:

- Riziko nesprávného ověření informací

- Čas potřebný k použití nástroje

- Potenciální zneužití jinými osobami

- Předpojatost v automatizovaných systémech

- Obavy týkající se ochrany soukromí a údajů