Clube «Jornalista» do Sindicato dos Jornalistas Búlgaros, Sófia

A EUalive, um meio de comunicação social pan-europeu e membro do consórcio AI4Debunk, organizou um debate público destinado a explorar a forma como as ferramentas baseadas na IA podem apoiar os esforços para combater as notícias falsas e a desinformação. O evento reuniu jornalistas e cidadãos para debater as necessidades, expectativas e preocupações da vida real relacionadas com a verificação de factos, a inteligência artificial e a confiança dos meios de comunicação social.

Participantes

Participaram no grupo de reflexão 12 participantes. A maioria eram jornalistas profissionais, predominantemente com mais de 60 anos, com opiniões geralmente mais conservadoras. Os participantes referiram consumir informações principalmente através de meios de comunicação social em linha, televisão e imprensa escrita, identificando simultaneamente o Facebook e as plataformas de notícias em linha como as principais fontes de desinformação.

Combater a desinformação sobre o evento

A discussão começou com a desmistificação de falsas alegações sobre o evento em si. A União dos Jornalistas Búlgaros (UBJ) negou categoricamente as alegações de que tinha convidado «propagandistas bielorrussos» para formação financiada pela UE sobre o combate às notícias falsas. O presidente da UBJ declarou que as acusações tiveram origem numa publicação enganosa do canal estatal bielorrusso Minsk News e foram posteriormente repetidas pelos meios de comunicação social da oposição bielorrussa sem verificação.

Na realidade, o evento foi um debate público de uma hora intitulado «Inteligência artificial e notícias falsas: What Is the Working Solution?», organizado pela EUalive e acolhido nas instalações da UBJ. O debate prosseguiu como previsto, apesar da controvérsia dos meios de comunicação social, salientando a rapidez com que a desinformação pode propagar-se mesmo nos meios de comunicação social profissionais.

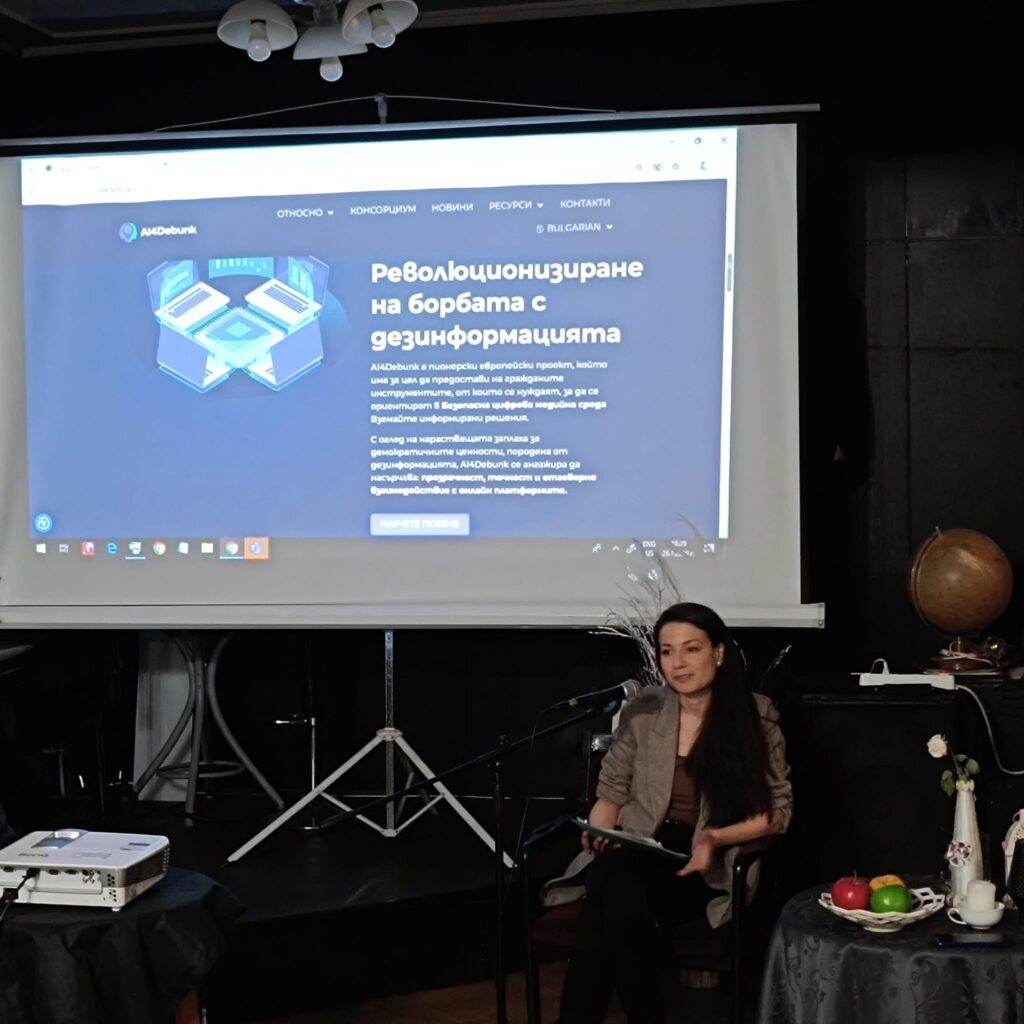

Apresentação do projeto AI4Debunk

A equipa da EUalive, liderada por Georgi Gotev, apresentou o projeto AI4Debunk, descrevendo os seus objetivos, os parceiros do consórcio e os progressos realizados até à data. Um representante da F6S forneceu informações adicionais sobre os aspetos tecnológicos do projeto e o papel das organizações parceiras. Foi salientado que o projeto tem um âmbito claramente definido e limitado: Apoiar os utilizadores na identificação e avaliação da desinformação, em vez de resolver questões sistémicas mais vastas, como a geração de imagens sintéticas ou a regulamentação global da IA.

Principais temas de discussão

Os participantes refletiram amplamente sobre o papel da inteligência artificial no ecossistema da informação. Foram debatidos vários exemplos para ilustrar a forma como informações incompletas ou apresentadas de forma seletiva podem gerar desinformação, incluindo casos relacionados com narrativas históricas e cobertura noticiosa internacional.

Um tema recorrente foi a natureza dual da IA. Enquanto alguns participantes viam a IA como uma ferramenta potencialmente poderosa para a verificação de factos, outros manifestaram preocupação com a sua utilização indevida, particularmente na geração de texto sintético, imagens e artigos que podem induzir o público em erro. Foram também levantadas questões relacionadas com o RGPD, a proteção das fontes e a capacidade dos jornalistas para defenderem o seu trabalho contra conteúdos gerados por IA.

O debate salientou que os sistemas de IA são tão fiáveis como os dados em que são treinados. Uma vez que as informações em linha são frequentemente imprecisas, tendenciosas ou intencionalmente enganosas, os participantes concordaram que não se pode esperar que a IA produza de forma consistente uma verdade objetiva. Esta limitação reforça a importância da literacia mediática, do julgamento humano, das normas profissionais e da responsabilidade editorial.

Literacia mediática, confiança e responsabilidade profissional

Vários participantes salientaram que a literacia mediática continua a ser a defesa mais crítica contra a desinformação, tanto agora como no futuro. Tanto os jornalistas como os cidadãos devem poder contestar as suas próprias crenças, sair das «bolhas de informação» algorítmicas e procurar diversas fontes. Foram manifestadas preocupações quanto às audiências que esperam que a IA forneça uma verdade absoluta, o que pode aumentar a vulnerabilidade à desinformação gerada ou amplificada pelos sistemas de IA.

Uma sondagem realizada durante o debate mostrou que a maioria dos participantes já utiliza ferramentas de IA no seu trabalho profissional. O moderador salientou a importância dos mecanismos societais para verificar as informações, bem como a necessidade de educação sobre o funcionamento da IA, incluindo a formulação rápida e a avaliação crítica dos resultados da IA. Foi igualmente debatido o papel dos sistemas educativos, em especial a introdução da IA e da literacia mediática nas escolas.

Direitos de Autor e Indústrias Criativas

A questão dos direitos de autor surgiu como uma grande preocupação. Os participantes observaram que a compensação por violação de direitos de autor na Bulgária é atualmente mínima, levantando questões sobre a forma como os autores, jornalistas, artistas e músicos podem proteger o seu trabalho na era da IA generativa. Alguns participantes expressaram opiniões fortes de que a IA representa uma ameaça direta para as indústrias criativas, tendo um jornalista defendido que a IA deve ser totalmente proibida de produzir arte.

Os participantes preencheram um inquérito resumido a seguir:

Exposição à desinformação

Os participantes indicaram que são os que mais frequentemente se deparam com desinformação sobre Facebook e em meios de comunicação social em linha.

Práticas de verificação

Quando questionados sobre a forma como verificam as informações que suspeitam serem falsas ou enganosas, os inquiridos referiram basear-se principalmente em:

- Motores de busca

- Fontes oficiais,

- Discussões com colegas, amigos

Formatos de prova preferidos

- Breves explicações escritas que descrevem claramente por que o conteúdo é enganoso

- Ligações diretas para fontes em linha fiáveis que apoiam a correção ou clarificação

Comunicação de desinformação

Os participantes foram questionados sobre como prefeririam assinalar ou denunciar desinformação ou notícias falsas. Os mecanismos de comunicação de informações mais favorecidos incluíram:

- Extensões de navegador, que permitem aos utilizadores sinalizar conteúdos diretamente no seu ambiente de navegação

- Aplicações móveis que oferecem acessibilidade e facilidade de utilização

Características preferidas do sistema

Quando questionados sobre que tipo de sistema seria mais útil para reconhecer a desinformação, os inquiridos identificaram as seguintes opções:

- Aplicação móvel

- Função integrada diretamente nas plataformas

- Base de dados pública e pesquisável de casos verificados

- Avisos ou rótulos assistidos por IA

Apresentação de elementos de prova e observações

Os inquiridos manifestaram preferência pela apresentação de elementos de prova sob a forma de uma simples ligação a uma fonte em linha que contenha as informações pertinentes. Além disso, verificou-se um forte acordo quanto ao facto de os utilizadores deverem receber reações após a apresentação de um relatório, tendo a maioria dos inquiridos indicado que a confirmação ou o seguimento aumentariam a confiança na ferramenta e a sua utilização continuada.

Motivação para utilizar uma ferramenta de desmistificação

Quando questionados sobre a sua principal motivação para utilizar uma ferramenta de deteção ou comunicação de desinformação, os inquiridos citaram:

- Combate à desinformação

- Melhorar a qualidade global da informação

- Contribuir para o debate público

Principais preocupações e riscos

Por último, os inquiridos identificaram várias preocupações relacionadas com instrumentos que exigem que os utilizadores apresentem elementos de prova:

- Risco de validação incorreta das informações

- Tempo necessário para utilizar a ferramenta

- Possível utilização indevida por terceiros

- Viés nos sistemas automatizados

- Preocupações em matéria de privacidade e proteção de dados