Club «Periodista» de la Unión de Periodistas Búlgaros, Sofía

EUalive, un medio de comunicación paneuropeo y miembro del consorcio AI4Debunk, organizó un debate público destinado a explorar cómo las herramientas impulsadas por la IA pueden apoyar los esfuerzos para contrarrestar las noticias falsas y la desinformación. El evento reunió a periodistas y ciudadanos para discutir las necesidades, expectativas y preocupaciones de la vida real relacionadas con la verificación de datos, la inteligencia artificial y la confianza de los medios de comunicación.

Participantes

Un total de 12 participantes asistieron al grupo focal. La mayoría eran periodistas profesionales, predominantemente mayores de 60 años, con puntos de vista generalmente más conservadores. Los participantes informaron que consumían información principalmente a través de medios de comunicación en línea, televisión y medios impresos, al tiempo que identificaban a Facebook y las plataformas de noticias en línea como las principales fuentes donde más a menudo se encuentran con la desinformación.

Abordar la desinformación sobre el evento

La discusión comenzó con la desacreditación de afirmaciones falsas sobre el evento en sí. La Unión de Periodistas Búlgaros (UBJ) negó categóricamente las acusaciones de haber invitado a «propagandistas bielorrusos» a recibir formación financiada por la UE sobre la lucha contra las noticias falsas. El presidente de la UBJ declaró que las acusaciones se originaron a partir de una publicación engañosa del medio estatal bielorruso Minsk News y luego se hicieron eco de los medios de la oposición bielorrusa sin verificación.

En realidad, el acto fue un debate público de una hora de duración titulado «Artificial Intelligence and Fake News: What Is the Working Solution?», organizado por EUalive y alojado en las instalaciones de la UBJ. La discusión procedió según lo planeado a pesar de la controversia de los medios, destacando la rapidez con que la desinformación puede propagarse incluso dentro de los círculos profesionales de los medios.

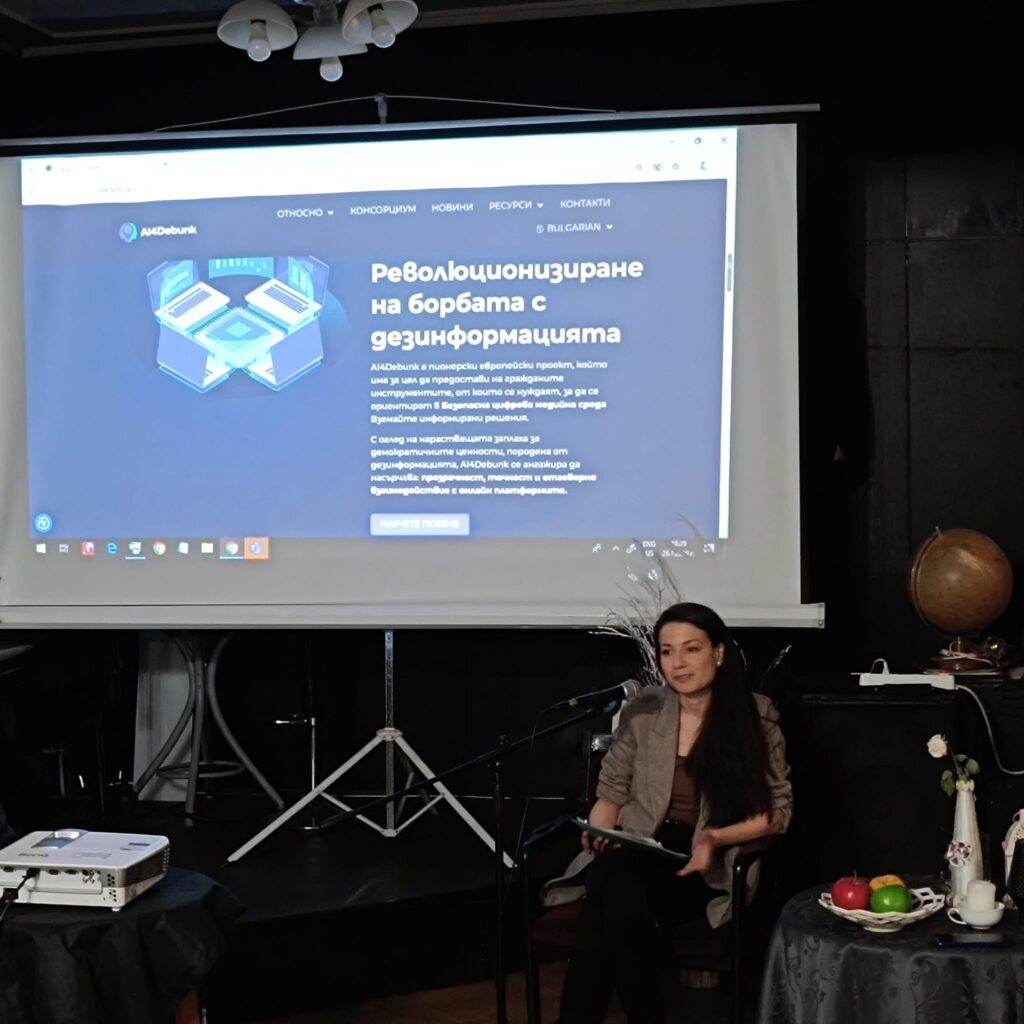

Presentación del proyecto AI4Debunk

El equipo de EUalive liderado por Georgi Gotev presentó el proyecto AI4Debunk, describiendo sus objetivos, socios del consorcio y avances hasta la fecha. Un representante de F6S proporcionó información adicional sobre los aspectos tecnológicos del proyecto y el papel de las organizaciones asociadas. Se hizo hincapié en que el proyecto tiene un alcance claramente definido y limitado: apoyar a los usuarios en la identificación y evaluación de la desinformación, en lugar de resolver problemas sistémicos más amplios, como la generación de imágenes sintéticas o la regulación general de la IA.

Temas clave de discusión

Los participantes reflexionaron ampliamente sobre el papel de la inteligencia artificial en el ecosistema de la información. Se discutieron varios ejemplos para ilustrar cómo la información incompleta o presentada selectivamente puede generar desinformación, incluidos casos relacionados con narrativas históricas y cobertura de noticias internacionales.

Un tema recurrente fue la naturaleza dual de la IA. Mientras que algunos participantes vieron la IA como una herramienta potencialmente poderosa para la verificación y verificación de hechos, otros expresaron su preocupación por su uso indebido, particularmente en la generación de texto sintético, imágenes y artículos que pueden engañar a las audiencias. También se plantearon cuestiones relacionadas con el RGPD, la protección de las fuentes y la capacidad de los periodistas para defender su trabajo contra los contenidos generados por la IA.

El debate puso de relieve que los sistemas de IA solo son tan fiables como los datos en los que están entrenados. Dado que la información en línea a menudo es inexacta, sesgada o intencionalmente engañosa, los participantes estuvieron de acuerdo en que no se puede esperar que la IA produzca consistentemente verdad objetiva. Esta limitación refuerza la importancia de la alfabetización mediática, el juicio humano, los estándares profesionales y la responsabilidad editorial.

Alfabetización mediática, confianza y responsabilidad profesional

Varios participantes destacaron que la alfabetización mediática sigue siendo la defensa más crítica contra la desinformación, tanto ahora como en el futuro. Tanto los periodistas como los ciudadanos deben poder cuestionar sus propias creencias, salir de las «burbujas de información» algorítmicas y buscar diversas fuentes. Se expresó preocupación por las audiencias que esperan que la IA ofrezca una verdad absoluta, lo que puede aumentar la vulnerabilidad a la desinformación generada o amplificada por los sistemas de IA.

Una encuesta realizada durante la discusión mostró que la mayoría de los participantes ya usan herramientas de IA en su trabajo profesional. El moderador hizo hincapié en la importancia de los mecanismos sociales para verificar la información, así como en la necesidad de educación sobre cómo funciona la IA, incluida la rápida formulación y evaluación crítica de los resultados de la IA. También se debatió el papel de los sistemas educativos, en particular la introducción de la IA y la alfabetización mediática en las escuelas.

Derechos de autor e industrias creativas

El tema de los derechos de autor surgió como una preocupación importante. Los participantes señalaron que la compensación por la infracción de derechos de autor en Bulgaria es actualmente mínima, lo que plantea preguntas sobre cómo los autores, periodistas, artistas y músicos pueden proteger su trabajo en la era de la IA generativa. Algunos participantes expresaron fuertes puntos de vista de que la IA representa una amenaza directa para las industrias creativas, y un periodista argumentó que la IA debería prohibirse por completo la producción artística.

Los participantes cumplimentaron una encuesta que se resume a continuación:

Exposición a la desinformación

Los participantes indicaron que con mayor frecuencia encuentran desinformación sobre Facebook y en medios de comunicación en línea.

Prácticas de verificación

Cuando se les preguntó cómo verifican la información que sospechan que puede ser falsa o engañosa, los encuestados informaron que confiaban principalmente en:

- Motores de búsqueda

- Fuentes oficiales,

- Discusiones con colegas, amigos

Formatos de evidencia preferidos

- Explicaciones breves por escrito que describen claramente por qué el contenido es engañoso

- Enlaces directos a fuentes en línea fiables que respalden la corrección o aclaración

Informar sobre la desinformación

Se preguntó a los participantes cómo preferirían señalar o denunciar la desinformación o las noticias falsas. Entre los mecanismos de presentación de informes más favorecidos figuran los siguientes:

- Extensiones de navegador, lo que permite a los usuarios marcar el contenido directamente dentro de su entorno de navegación

- Aplicaciones móviles, que ofrecen accesibilidad y facilidad de uso

Características preferidas del sistema

Cuando se les preguntó qué tipo de sistema sería más útil para reconocer la desinformación, los encuestados identificaron las siguientes opciones:

- Aplicación móvil

- Función integrada directamente en las plataformas

- Base de datos pública y consultable de casos verificados

- Advertencias o etiquetas asistidas por IA

Presentación de pruebas y comentarios

Los encuestados expresaron su preferencia por presentar pruebas en forma de un simple enlace a una fuente en línea que contuviera la información pertinente. Además, hubo un fuerte acuerdo en que los usuarios deberían recibir comentarios después de presentar un informe, y la mayoría de los encuestados indicaron que la confirmación o el seguimiento aumentarían la confianza y el uso continuo de la herramienta.

Motivación para usar una herramienta de desacreditación

Cuando se les preguntó sobre su motivación principal para usar una herramienta de detección o notificación de desinformación, los encuestados citaron:

- Lucha contra la desinformación

- Mejora de la calidad general de la información

- Contribuir al debate público

Preocupaciones y riesgos clave

Por último, los encuestados identificaron varias preocupaciones relacionadas con las herramientas que requieren que los usuarios presenten pruebas:

- Riesgo de validación incorrecta de la información

- Tiempo necesario para utilizar la herramienta

- Posible uso indebido por parte de terceros

- Sesgo en los sistemas automatizados

- Problemas de privacidad y protección de datos