Club "Giornalista" presso l'Unione dei giornalisti bulgari, Sofia

EUalive, un organo di informazione paneuropeo e membro del consorzio AI4Debunk, ha organizzato una discussione pubblica volta a esplorare in che modo gli strumenti basati sull'IA possano sostenere gli sforzi per contrastare le notizie false e la disinformazione. L'evento ha riunito giornalisti e cittadini per discutere le esigenze della vita reale, le aspettative e le preoccupazioni relative al controllo dei fatti, all'intelligenza artificiale e alla fiducia dei media.

Partecipanti

Un totale di 12 partecipanti hanno partecipato al focus group. La maggior parte erano giornalisti professionisti, prevalentemente di età superiore ai 60 anni, con opinioni generalmente più conservatrici. I partecipanti hanno riferito di aver consumato informazioni principalmente attraverso i mezzi di informazione online, la televisione e la stampa, identificando Facebook e le piattaforme di notizie online come le fonti primarie in cui incontrano più spesso la disinformazione.

Affrontare la disinformazione sull'evento

La discussione si è aperta con la smentita di false affermazioni riguardanti l'evento stesso. L'Unione dei giornalisti bulgari (UBJ) ha categoricamente negato di aver invitato "propagandisti bielorussi" per una formazione finanziata dall'UE sulla lotta alle notizie false. Il presidente dell'UBJ ha dichiarato che le accuse provenivano da una pubblicazione fuorviante dell'emittente statale bielorussa Minsk News e sono state successivamente riprese dai media dell'opposizione bielorussa senza verifica.

In realtà, l'evento è stato un dibattito pubblico di un'ora dal titolo "Intelligenza artificiale e notizie false: What Is the Working Solution?", organizzata da EUalive e ospitata presso la sede dell'UBJ. La discussione è proseguita come previsto nonostante le polemiche mediatiche, evidenziando quanto velocemente la disinformazione possa diffondersi anche all'interno dei circoli mediatici professionali.

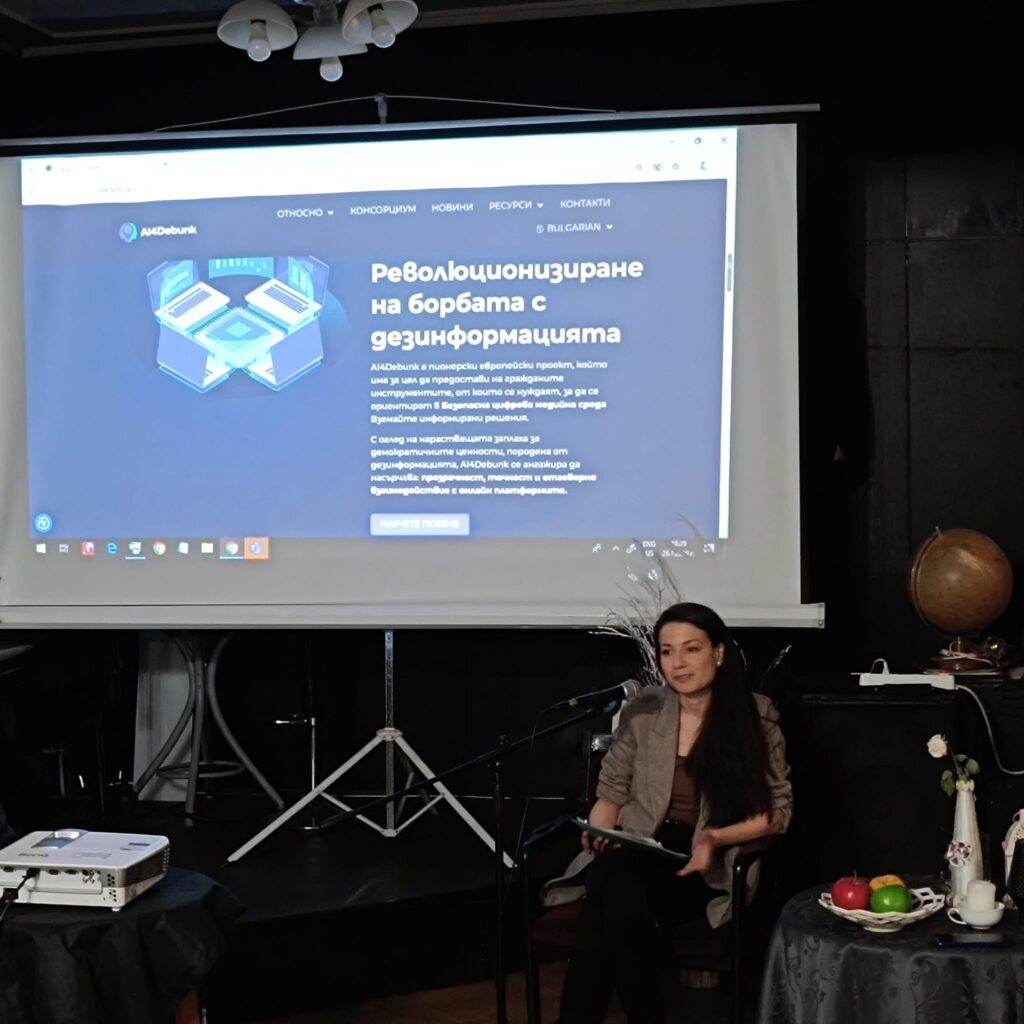

Presentazione del progetto AI4Debunk

Il team EUalive guidato da Georgi Gotev ha presentato il progetto AI4Debunk, delineandone gli obiettivi, i partner del consorzio e i progressi compiuti fino ad oggi. Un rappresentante di F6S ha fornito ulteriori approfondimenti sugli aspetti tecnologici del progetto e sul ruolo delle organizzazioni partner. È stato sottolineato che il progetto ha una portata chiaramente definita e limitata: sostenere gli utenti nell'individuazione e nella valutazione della disinformazione, anziché risolvere questioni sistemiche più ampie come la generazione di immagini sintetiche o la regolamentazione generale dell'IA.

Temi chiave della discussione

I partecipanti hanno riflettuto ampiamente sul ruolo dell'intelligenza artificiale nell'ecosistema dell'informazione. Sono stati discussi diversi esempi per illustrare come informazioni incomplete o presentate in modo selettivo possano generare disinformazione, compresi casi relativi a narrazioni storiche e copertura di notizie internazionali.

Un tema ricorrente era la duplice natura dell'IA. Mentre alcuni partecipanti hanno visto l'IA come uno strumento potenzialmente potente per il controllo e la verifica dei fatti, altri hanno espresso preoccupazione per il suo uso improprio, in particolare nella generazione di testo sintetico, immagini e articoli che potrebbero indurre in errore il pubblico. Sono state inoltre sollevate questioni relative al GDPR, alla protezione delle fonti e alla capacità dei giornalisti di difendere il proprio lavoro dai contenuti generati dall'IA.

La discussione ha evidenziato che i sistemi di IA sono affidabili solo quanto i dati su cui sono addestrati. Poiché le informazioni online sono spesso imprecise, distorte o intenzionalmente fuorvianti, i partecipanti hanno convenuto che non ci si può aspettare che l'IA produca costantemente verità oggettive. Questa limitazione rafforza l'importanza dell'alfabetizzazione mediatica, del giudizio umano, degli standard professionali e della responsabilità editoriale.

Alfabetizzazione mediatica, fiducia e responsabilità professionale

Diversi partecipanti hanno sottolineato che l'alfabetizzazione mediatica rimane la difesa più critica contro la disinformazione, sia ora che in futuro. Giornalisti e cittadini devono essere in grado di mettere in discussione le proprie convinzioni, uscire dalle "bolle informative" algoritmiche e cercare fonti diverse. Sono state sollevate preoccupazioni in merito al pubblico che si aspetta che l'IA fornisca la verità assoluta, il che può aumentare la vulnerabilità alla disinformazione generata o amplificata dai sistemi di IA.

Un sondaggio condotto durante la discussione ha dimostrato che la maggior parte dei partecipanti utilizza già strumenti di IA nel proprio lavoro professionale. Il moderatore ha sottolineato l'importanza dei meccanismi sociali per la verifica delle informazioni, nonché la necessità di un'educazione sul funzionamento dell'IA, compresa la formulazione tempestiva e la valutazione critica dei risultati dell'IA. È stato inoltre discusso il ruolo dei sistemi di istruzione, in particolare l'introduzione dell'IA e dell'alfabetizzazione mediatica nelle scuole.

Diritto d'autore e industrie creative

La questione del diritto d'autore è emersa come una delle principali preoccupazioni. I partecipanti hanno osservato che il risarcimento per la violazione del copyright in Bulgaria è attualmente minimo, sollevando domande su come autori, giornalisti, artisti e musicisti possano proteggere il loro lavoro nell'era dell'IA generativa. Alcuni partecipanti hanno espresso forti opinioni sul fatto che l'IA rappresenti una minaccia diretta per le industrie creative, con un giornalista che sostiene che l'IA dovrebbe essere bandita del tutto dalla produzione artistica.

I partecipanti hanno compilato un sondaggio sintetizzato di seguito:

Esposizione alla disinformazione

I partecipanti hanno indicato che incontrano più frequentemente disinformazione su Facebook e in mezzi di informazione online.

Pratiche di verifica

Alla domanda su come verificare le informazioni che sospettano possano essere false o fuorvianti, i rispondenti hanno riferito di fare affidamento principalmente su:

- Motori di ricerca

- Fonti ufficiali,

- Discussioni con colleghi, amici

Formati di prova preferiti

- Brevi spiegazioni scritte che delineano chiaramente il motivo per cui il contenuto è fuorviante

- Link diretti a fonti online affidabili a sostegno della correzione o del chiarimento

Segnalazione di disinformazione

Ai partecipanti è stato chiesto come preferirebbero segnalare o segnalare disinformazione o notizie false. I meccanismi di segnalazione più favoriti comprendevano:

- Estensioni del browser, che consentono agli utenti di contrassegnare i contenuti direttamente all'interno del loro ambiente di navigazione

- Applicazioni mobili, che offrono accessibilità e facilità d'uso

Caratteristiche di sistema preferite

Alla domanda su quale tipo di sistema sarebbe più utile per riconoscere la disinformazione, gli intervistati hanno individuato le seguenti opzioni:

- Applicazione mobile

- Funzione integrata direttamente nelle piattaforme

- Banca dati pubblica e consultabile dei casi verificati

- Avvertenze o etichette assistite dall'IA

Presentazione di prove e feedback

I rispondenti hanno espresso la preferenza per la presentazione di prove sotto forma di un semplice collegamento a una fonte online contenente le informazioni pertinenti. Inoltre, vi è stato un forte accordo sul fatto che gli utenti dovrebbero ricevere un feedback dopo aver presentato una relazione, con la maggior parte dei rispondenti che indica che la conferma o il follow-up aumenterebbero la fiducia e l'uso continuato dello strumento.

Motivazione per l'utilizzo di uno strumento di debunking

Alla domanda sulla loro motivazione principale per l'utilizzo di uno strumento di rilevamento o segnalazione della disinformazione, gli intervistati hanno citato:

- Lotta alla disinformazione

- Migliorare la qualità generale delle informazioni

- Contribuire al dibattito pubblico

Principali preoccupazioni e rischi

Infine, i rispondenti hanno individuato diverse preoccupazioni relative agli strumenti che richiedono agli utenti di presentare prove:

- Rischio di errata convalida delle informazioni

- Tempo necessario per utilizzare lo strumento

- Potenziale uso improprio da parte di altri

- Bias nei sistemi automatizzati

- Preoccupazioni in materia di privacy e protezione dei dati