Club «Journaliste» à l’Union des journalistes bulgares, Sofia

EUalive, un média paneuropéen et membre du consortium AI4Debunk, a organisé un débat public visant à explorer comment les outils fondés sur l’IA peuvent soutenir les efforts visant à lutter contre les fausses informations et la désinformation. L'événement a réuni des journalistes et des citoyens pour discuter des besoins, des attentes et des préoccupations de la vie réelle liés à la vérification des faits, à l'intelligence artificielle et à la confiance des médias.

Participants

Au total, 12 participants ont participé au groupe de discussion. La majorité étaient des journalistes professionnels, principalement âgés de plus de 60 ans, avec des opinions généralement plus conservatrices. Les participants ont déclaré consommer des informations principalement par l’intermédiaire de médias d’information en ligne, de la télévision et de la presse écrite, tout en identifiant Facebook et les plateformes d’information en ligne comme les principales sources où ils rencontrent le plus souvent de la désinformation.

Lutter contre la désinformation à propos de l'événement

La discussion s'est ouverte avec la démystification des fausses affirmations concernant l'événement lui-même. L’Union des journalistes bulgares (UBJ) a catégoriquement nié les allégations selon lesquelles elle aurait invité des «propagandistes biélorusses» à suivre une formation financée par l’UE sur la lutte contre les fausses informations. Le président de l'UBJ a déclaré que les accusations provenaient d'une publication trompeuse du média d'État biélorusse Minsk News et ont ensuite été reprises par les médias d'opposition biélorusses sans vérification.

En réalité, il s’agissait d’une discussion publique d’une heure intitulée «Intelligence artificielle et fausses nouvelles: What Is the Working Solution?», organisée par EUalive et hébergée dans les locaux de l’UBJ. La discussion s’est déroulée comme prévu malgré la controverse médiatique, soulignant la rapidité avec laquelle la désinformation peut se propager, même au sein des milieux médiatiques professionnels.

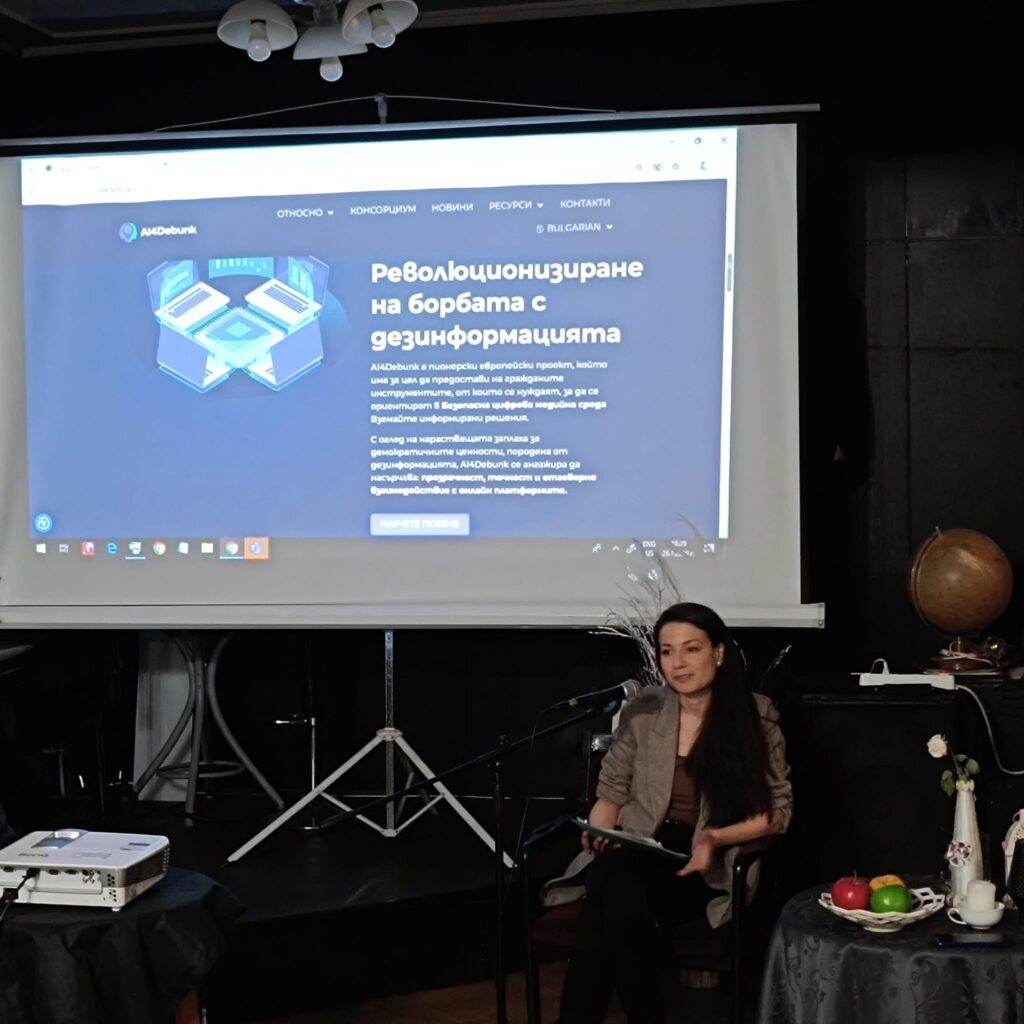

Présentation du projet AI4Debunk

L'équipe EUalive dirigée par Georgi Gotev a présenté le projet AI4Debunk, en décrivant ses objectifs, les partenaires du consortium et les progrès réalisés à ce jour. Un représentant de F6S a fourni des informations supplémentaires sur les aspects technologiques du projet et le rôle des organisations partenaires. Il a été souligné que le projet avait une portée clairement définie et limitée: soutenir les utilisateurs dans l’identification et l’évaluation de la désinformation, plutôt que de résoudre des problèmes systémiques plus larges tels que la génération d’images synthétiques ou la réglementation globale de l’IA.

Thèmes de discussion clés

Les participants ont longuement réfléchi au rôle de l’intelligence artificielle dans l’écosystème de l’information. Plusieurs exemples ont été discutés pour illustrer comment des informations incomplètes ou présentées de manière sélective peuvent générer de la désinformation, y compris des cas liés à des récits historiques et à une couverture médiatique internationale.

Un thème récurrent était la double nature de l'IA. Alors que certains participants considéraient l'IA comme un outil potentiellement puissant pour la vérification des faits et la vérification, d'autres ont exprimé des préoccupations quant à son utilisation abusive, en particulier dans la génération de textes, d'images et d'articles synthétiques susceptibles d'induire le public en erreur. Des questions liées au RGPD, à la protection des sources et à la capacité des journalistes à défendre leur travail contre les contenus générés par l’IA ont également été soulevées.

La discussion a mis en évidence que les systèmes d’IA ne sont aussi fiables que les données sur lesquelles ils sont formés. Étant donné que l'information en ligne est souvent inexacte, biaisée ou intentionnellement trompeuse, les participants ont convenu qu'on ne peut s'attendre à ce que l'IA produise systématiquement une vérité objective. Cette limitation renforce l'importance de l'éducation aux médias, du jugement humain, des normes professionnelles et de la responsabilité éditoriale.

Alphabétisation des médias, confiance et responsabilité professionnelle

Plusieurs participants ont souligné que l’éducation aux médias demeure la défense la plus critique contre la désinformation, tant aujourd’hui qu’à l’avenir. Les journalistes et les citoyens doivent être en mesure de contester leurs propres croyances, de sortir des «bulles d’information» algorithmiques et de rechercher des sources diverses. Des inquiétudes ont été exprimées quant au fait que les publics s’attendent à ce que l’IA fournisse une vérité absolue, ce qui pourrait accroître la vulnérabilité à la désinformation générée ou amplifiée par les systèmes d’IA.

Un sondage mené au cours de la discussion a montré que la plupart des participants utilisent déjà des outils d'IA dans leur travail professionnel. Le modérateur a souligné l’importance des mécanismes sociétaux pour la vérification des informations, ainsi que la nécessité d’une éducation sur le fonctionnement de l’IA, y compris une formulation rapide et une évaluation critique des résultats de l’IA. Le rôle des systèmes éducatifs, en particulier l’introduction de l’IA et de l’éducation aux médias dans les écoles, a également été abordé.

Droit d'auteur et industries créatives

La question du droit d'auteur est apparue comme une préoccupation majeure. Les participants ont noté que l'indemnisation pour violation du droit d'auteur en Bulgarie est actuellement minime, ce qui soulève des questions sur la façon dont les auteurs, les journalistes, les artistes et les musiciens peuvent protéger leur travail à l'ère de l'IA générative. Certains participants ont exprimé des points de vue fermes selon lesquels l’IA constitue une menace directe pour les industries créatives, un journaliste faisant valoir que l’IA devrait être totalement interdite de production artistique.

Les participants ont répondu à une enquête résumée ci-dessous:

Exposition à la désinformation

Les participants ont indiqué qu’ils rencontraient le plus souvent de la désinformation sur Facebook et dans médias d’information en ligne.

Pratiques de vérification

Lorsqu'on leur a demandé comment ils vérifiaient que les informations qu'ils soupçonnaient d'être fausses ou trompeuses, les répondants ont déclaré s'appuyer principalement sur:

- Moteurs de recherche

- Sources officielles,

- Discussions avec des collègues, des amis

Formats de preuves préférés

- De brèves explications écrites qui expliquent clairement pourquoi le contenu est trompeur

- Liens directs vers des sources en ligne fiables à l’appui de la correction ou de la clarification

Signalement de la désinformation

On a demandé aux participants comment ils préféreraient signaler ou signaler la désinformation ou les fausses nouvelles. Les mécanismes d'établissement de rapports les plus favorisés étaient les suivants:

- Extensions de navigateur, permettant aux utilisateurs de signaler le contenu directement dans leur environnement de navigation

- Applications mobiles, offrant accessibilité et facilité d'utilisation

Caractéristiques du système préféré

Lorsqu’on leur a demandé quel type de système serait le plus utile pour reconnaître la désinformation, les répondants ont identifié les options suivantes:

- Application mobile

- Fonction intégrée directement dans les plateformes

- Base de données publique consultable des cas vérifiés

- Avertissements ou étiquettes assistés par l’IA

Présentation d’éléments de preuve et de commentaires

Les répondants ont exprimé leur préférence pour la présentation d’éléments de preuve sous la forme d’un simple lien vers une source en ligne contenant les informations pertinentes. En outre, il y avait un fort consensus sur le fait que les utilisateurs devraient recevoir des commentaires après avoir soumis un rapport, la plupart des répondants indiquant que la confirmation ou le suivi augmenterait la confiance et l'utilisation continue de l'outil.

Motivation pour l'utilisation d'un outil de débunking

Interrogés sur leur motivation principale à utiliser un outil de détection ou de signalement de la désinformation, les répondants ont cité:

- Lutte contre la désinformation

- Améliorer la qualité globale de l'information

- Contribuer au débat public

Principales préoccupations et risques

Enfin, les répondants ont relevé plusieurs préoccupations liées aux outils qui obligent les utilisateurs à présenter des éléments de preuve:

- Risque de validation incorrecte des informations

- Temps nécessaire à l'utilisation de l'outil

- Utilisation abusive potentielle par d'autres

- Biais dans les systèmes automatisés

- Préoccupations relatives à la vie privée et à la protection des données